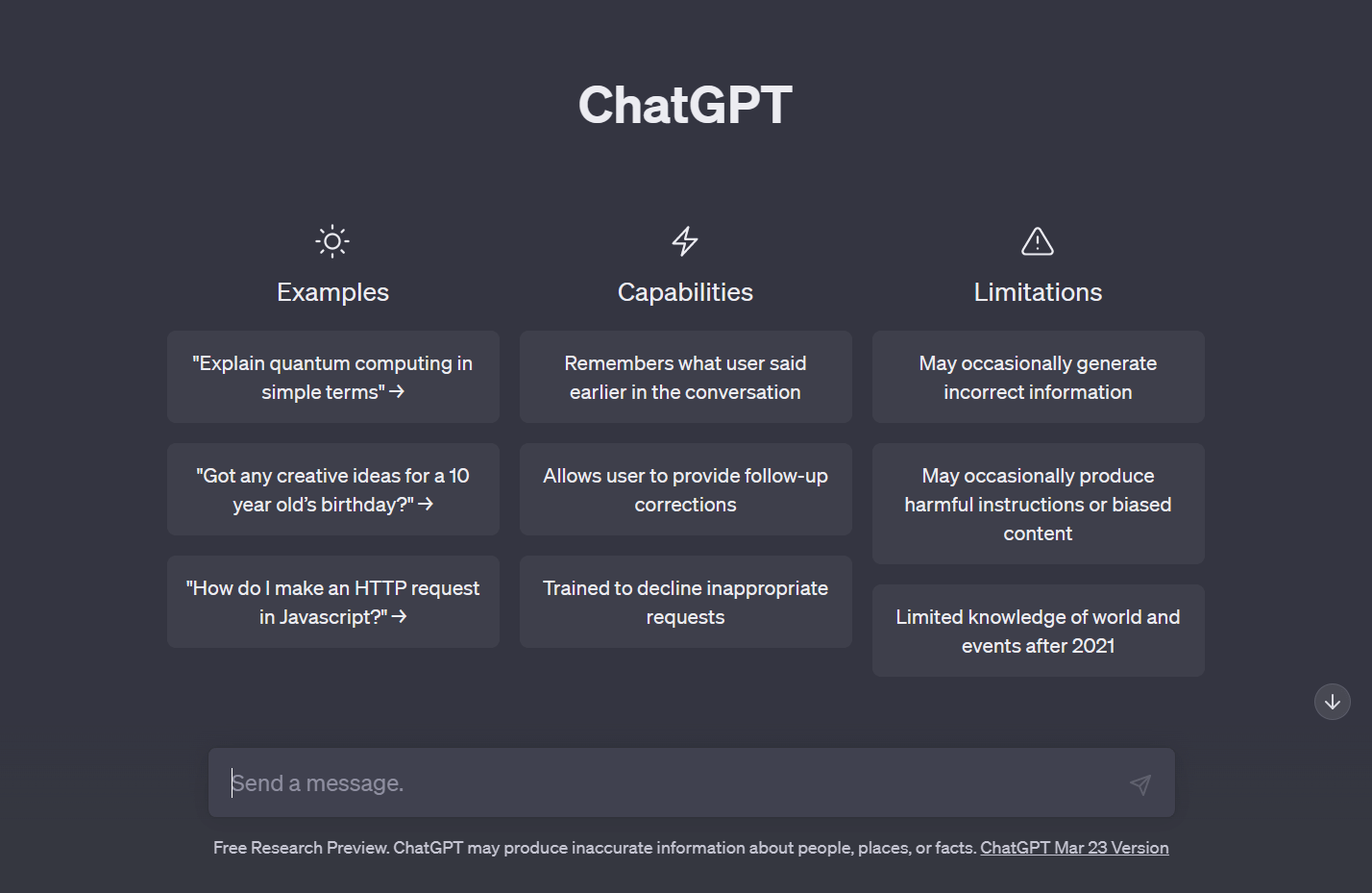

ChatGPT เป็น LLM ระดับ Advance มันจะพยายามอย่างที่สุดที่จะตอบคำถามที่เราป้อนให้ จากข้อมูลมหาศาลที่มันถูกเทรนมา อย่างไรก็ตามมันไม่มีข้อมูลความรู้จากโลกความเป็นจริงที่เป็นปัจจุบัน ไม่สามารถเข้าใจบริบทอื่น ๆ นอกจากที่อยู่ในใน Training Data ดังนั้นเมื่อเราถามคำถาม หรือสั่งอะไรที่เป็นไปไม่ได้ บางทีมันจะสร้างคำตอบที่ฟังดูดี แต่อาจจะไม่เป็นความจริง ตอบกลับมาให้เราได้ ทางแก้ก็คือเราควรรู้เท่าทัน เข้าใจว่ามันคือ โปรแกรมคอมพิวเตอร์โปรแกรมหนึ่ง ซึ่งมีข้อจำกัด ไม่สามารถรู้ทุกอย่าง ไม่สามารถทำได้ทุกอย่าง ไม่สามารถทำสิ่งที่เป็นไปไม่ได้ให้เป็นไปได้ และสั่งให้มันตรวจเช็คเงื่อนไขที่จำเป็นก่อนทำงาน ไม่ได้ก็ตอบว่าไม่ได้ตรง ๆ

Tag Archives: ai

ChatGPT คืออะไร ChatGPT มีค่าใช้จ่ายไหม ChatGPT นำมาใช้ประโยชน์อะไร

ChatGPT คือ แชทบอทปัญญาประดิษฐ์ (AI Chatbot) ที่ถูกสร้างโดย OpenAI เปิดตัวเมื่อ เดือน พฤษจิกายน 2022 OpenAI พัฒนา ChatGPT ขึ้นมาโดยใช้เทคนิค Deep Learning โดยถูกสร้างต่อยอดจากโมเดล GPT-3.5 และ GPT-4 ซึ่งเป็น โมเดลภาษาขนาดใหญ่ (LLM) ที่ถูกเทรนด้วยข้อมูลข้อความจำนวนมหาศาลจากอินเทอร์เน็ต ChatGPT ถูกออกแบบให้เข้าใจ และสร้างข้อความภาษาธรรมชาติ Natural Language (ภาษาที่คนใช้ในชีวิตประจำวันทั่วไป)

สอน fastai2 จำแนกรูปภาพ Pets หมา แมว 37 สายพันธุ์ ด้วย Machine Learning, Deep Neural Networks – Image Classification ep.7

จาก ep ที่แล้ว AI จำแนกรูปภาพ หมา แมว 37 สายพันธุ์ เราได้ใช้ fastai version 1 ในการทำ Image Classification ได้ผลลัพธ์แม่นยำ 94% โดยใช้เวลาเทรนเพียงแค่ไม่เกิน 5 นาที กับ Code หลัก ๆ เพียงแค่ 3 บรรทัด เวลาผ่านไปหลายเดือน ขณะนี้ fastai ออกเวอร์ชันใหม่ เป็น fastai2 มี API ที่เปลี่ยนไปเล็กน้อย เน้นความยืดหยุ่นมากขึ้น ช่วยให้เราเทรนโมเดล และข้อมูลที่มีความซับซ้อนได้อย่างสะดวกยิ่งขึ้น

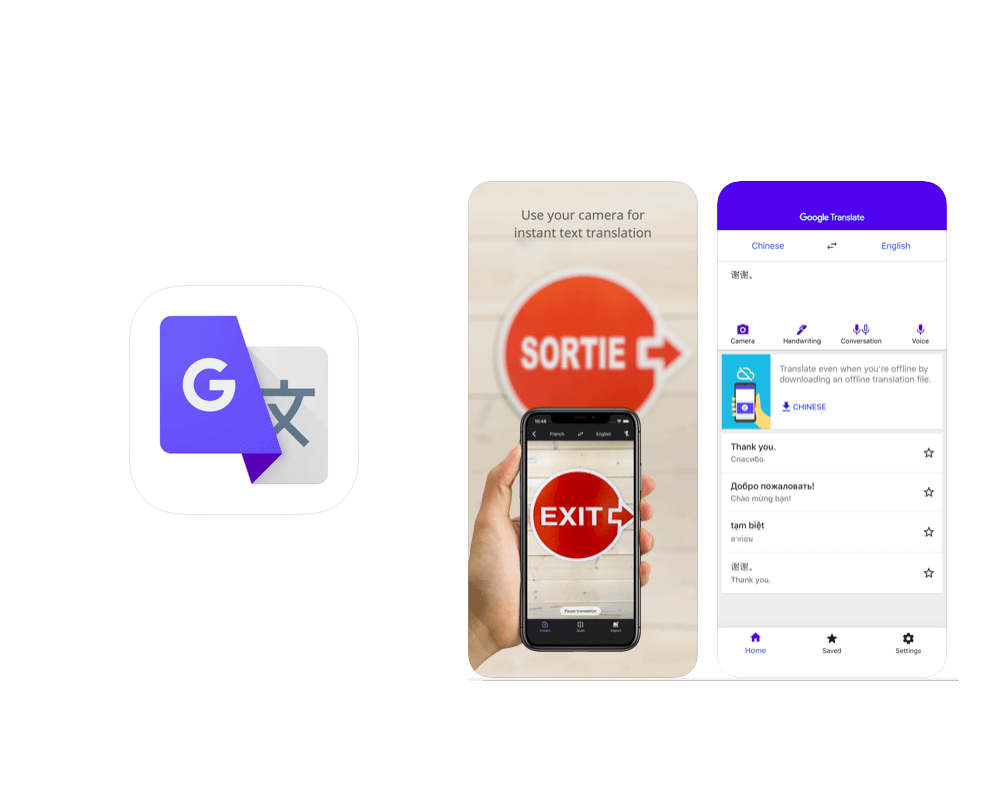

Transformer คืออะไร Self-Attention คืออะไร สอน Neural Machine Translation แปลภาษาฝรั่งเศส เป็นภาษาอังกฤษ ด้วย Transformer – NLP ep.12

จาก ep ที่แล้ว Neural Machine Translation แปลภาษาฝรั่งเศส เป็นภาษาอังกฤษ ด้วย Sequence to Sequence RNN/GRU Model และ Attention ใน ep นี้ เราจะมาเรียนรู้เรื่อง NLP ในงาน Neural Machine Translation กันต่อ แต่แทนที่จะใช้ RNN เหมือน ep ก่อน ๆ ใน ep นี้เราจะใช้สถาปัตยกรรมใหม่ ที่เรียกว่า Transformer ที่เน้น Attention แทนการใช้ RNN ว่าจะมีประสิทธิภาพเพิ่มขึ้นอย่างไร

Attention Mechanism คืออะไร ใน Neural Network สอน Neural Machine Translation แปลภาษาฝรั่งเศส เป็นภาษาอังกฤษ ด้วย Sequence to Sequence RNN Model และ Attention Mechanism – NLP ep.11

จาก ep ที่แล้ว Neural Machine Translation แปลภาษาฝรั่งเศส เป็นภาษาอังกฤษ ด้วย Sequence to Sequence RNN Model ใน ep นี้ เราจะมาเรียนรู้ Neural Machine Translation กันต่อ แต่จะใช้เทคนิคที่เรียกว่า Attention Mechanism มาเพิ่มประสิทธิภาพของโมเดล

โมเดล Sequence to Sequence คืออะไร Neural Machine Translation แปลภาษาฝรั่งเศส เป็นภาษาอังกฤษ ด้วย Sequence to Sequence RNN Model เทรนด้วย Teacher Forcing – NLP ep.10

ใน ep นี้เราจะเรียนรู้งานที่สำคัญอีกอย่างหนึ่งใน NLP คือ งานแปลภาษาด้วยเครื่อง หรือ Machine Translation หรือ Neural Machine Transation โดยใช้โมเดลแบบ Sequence to Sequence Recurrent Neural Network (RNN)

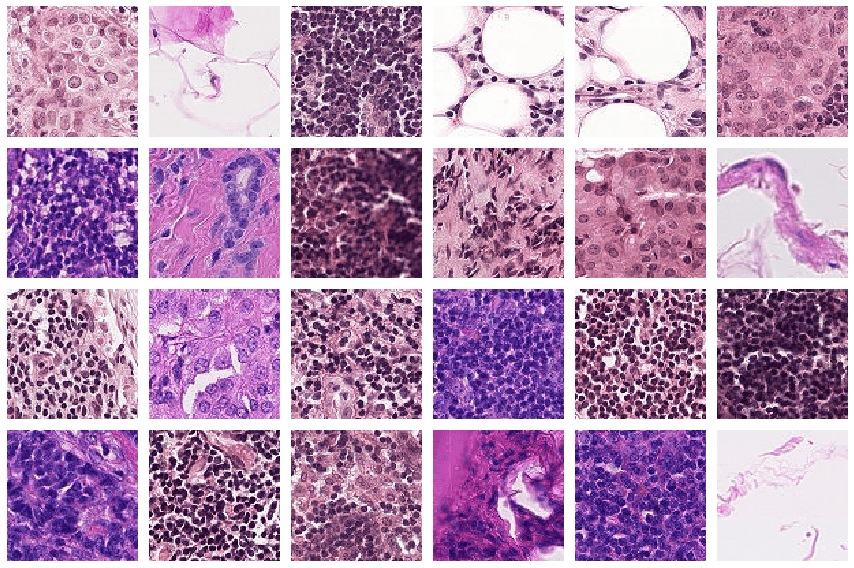

AI การแพทย์ วินิจฉัยโรคมะเร็งระยะลุกลาม (Metastatic Cancer) อัตโนมัติ จากรูปแผ่นสไลด์ดิจิตอล โดยใช้ Machine Learning, Deep Neural Network – Image Classification ep.6

ใน ep นี้ เราจะมาสร้างโมเดลที่ใช้จำแนก โรคมะเร็งระยะลุกลาม Metastatic Cancer จากรูปภาพ Patch เล็ก ๆ ของ Whole Slide Imaging ที่ตัดมาจาก Digital Pathology Scans รูปใหญ่

Mixup Data Augmentation และ Label Smoothing คืออะไร ใน Machine Learning – Regularization ep.3

จากใน ep เรื่อง AI จำแนกรูปภาพ Image Classification หมา แมว 37 สายพันธุ์ ใน ep นี้เราจะมาเรียนรู้เทคนิคเพิ่มเติม ในเรื่อง Data Augmentation คือ Mixup และ Loss Function คือ Label Smoothing เพื่อแก้ปัญหาบางอย่างในการเทรนโมเดล Machine Learning ให้มีประสิทธิภาพดีขึ้น

lr_find หา Learning Rate ที่ดีที่สุดในการเทรน Machine Learning โมเดล Deep Neural Network ด้วย Callback – Neural Network ep.12

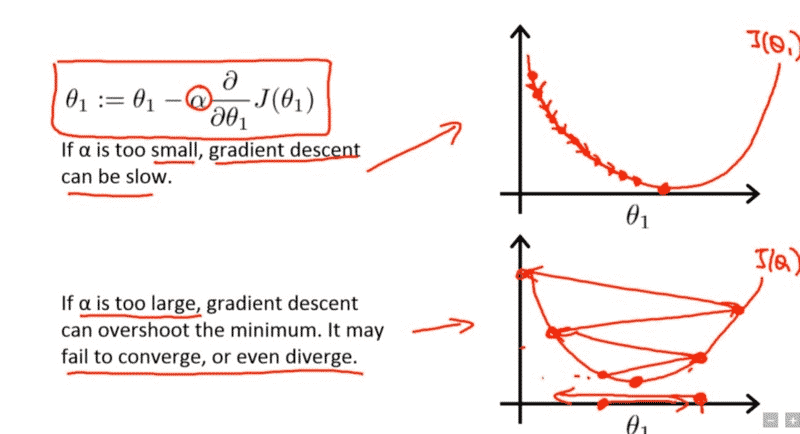

จาก ep ก่อน เราได้รู้จัก Hyperparameter ที่สำคัญที่สุดในการเทรน Machine Learning ชื่อ Learning Rate แต่ปัญหาคือ ถ้าเรากำหนดค่า Learning น้อยไปก็ทำให้เทรนได้ช้า แต่ถ้ามากเกินไปก็ทำให้ไม่ Converge หรืออาจจะ Error ไปเลย แล้วเราจะมีวิธีใด ที่จะหาค่า Learning Rate ที่ดีที่สุด มาใช้เทรน Deep Neural Network ของเรา

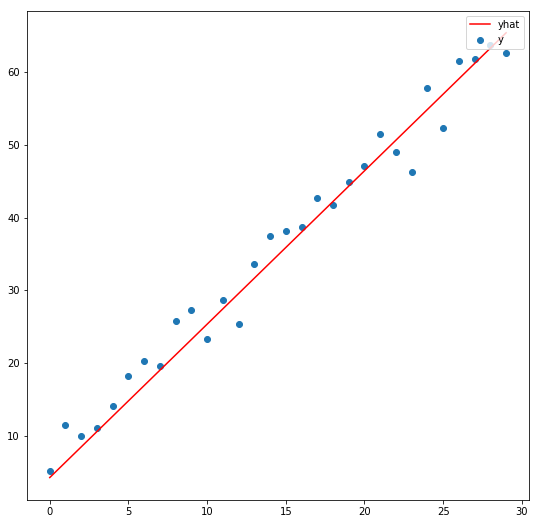

ตัวอย่าง Linear Regression ด้วย Stochastic Gradient Descent (SGD) พื้นฐานของ Neural Network – Optimization ep.2

จาก ep ที่แล้วที่เราเล่าถึงคอนเซ็ปต์ของ SGD ไป ใน ep นี้เราจะมาดูตัวอย่างโค้ดแบบง่ายที่สุด ซับซ้อนน้อยที่สุด ซึ่งเป็นพื้นฐานสำคัญของ Machine Learning แบบ Neural Network คือ Linear Regression ด้วยอัลกอริทึม Stochastic Gradient Descent (SGD) แต่ในการหา Slope นั้นเราไม่ต้อง Diff เอง แต่เราจะใช้ความสามารถ ของ Pytorch เรียกว่า Autograd หา Gredient ของ Parameter ทุกตัวให้โดยอัตโนมัติ