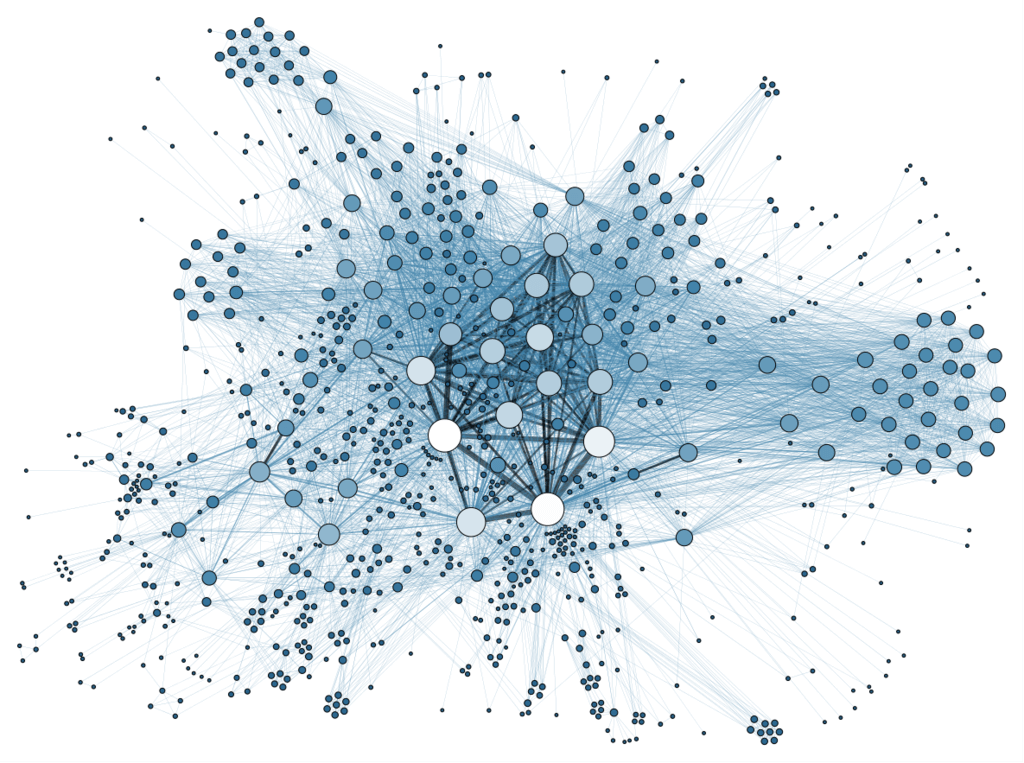

LangChain AI has an exciting feature that supports knowledge graph data represented as triplets structures using the RDF framework. This implementation provides two LLM-supported triplets operations: graph extraction and graph Q&A. By default, LangChain uses LLMs such as GPT-3, GPT-4 to extract knowledge triplets from text and store them in a NetworkX directed graph.

Category Archives: Deep Learning

Secrets Revealed: How LangChain’s Entity Memory Gives You Tailored Responses!

LangChain is a conversational AI framework that provides memory modules to help bots understand the context of a conversation. One of these modules is the Entity Memory, a more complex type of memory that extracts and summarizes entities from the conversation.

Unlock the Secret to Lifelike Chatbots: Conversational Memory Revealed!

By default, LLMs, Chains and Agents are stateless. They operate independently on each incoming query, without retaining any memory of previous interactions. However, in certain applications like chatbots, it is crucial to remember past conversations in both the short and long term. This is where the Memory feature comes into play.

LangChain: The Secret Sauce to Building Next-Level Language Applications

LangChain is a framework that revolves around large language models (LLMs). It enables the development of applications using LLMs for various purposes like chatbots, generative question-answering, summarization, and more.

สอนเขียน Prompt ChatGPT จงแสดงวิธีทำ Zero Shot Chain of Thought (Zero-shot-CoT) – Prompt Engineering ep.5

Prompt Engineering เป็นศาสตร์ที่เกี่ยวกับการออกแบบ Prompt หรือคำสั่ง ที่จะชี้นำโมเดลภาษา (Language Model) ให้ผลิตผลลัพท์ที่เราต้องการ เวลาที่เราออกแบบ Prompt สำหรับงานที่ซับซ้อน เราจำเป็นต้องให้โมเดลมีเวลาในการคิด และแตกงานที่ซับซ้อนออกเป็นขั้นตอนย่อย เนื่องจากโมเดลภาษา LLM ต้องการเวลาในการประมวผลข้อมูล และตอบคำถาม เช่นเดียวกับมนุษย์ ยกตัวอย่างเช่น มนุษย์ ใช้เวลาในการ คุณเลข 5 x 6 แค่ 1 วินาที แต่ใช้เวลา 10 วินาที ในการคูณเลข 55 x 65 แล้วใช้เวลามากขึ้นเรื่อย ๆ สำหรับการคูณเลข 555 x 656 โมเดลภาษาก็ต้องการเวลาเพิ่มเช่นกัน แต่เราจะมีวิธีเขียน Prompt บอกโมเดลให้ใช้เวลาคิดเพิ่มเต็มที่เลยได้ยังไง

สอนเขียน Prompt ChatGPT ยกตัวอย่างผลลัพธ์ที่อยากได้ Few-Shot Prompting – Prompt Engineering ep.4

Prompt Engineering จะตีโจทย์ว่าเป็นงานหรือปัญหาบางอย่างที่ต้องการให้โมเดล Machine Learning หรือ LLM มาช่วยหาคำตอบ โจทย์สามารถมีได้หลากหลายตั้งแต่ ตรวจคำผิด คัดแยกอีเมล์สแปม Sentiment Analysis แปลภาษา ไปจนถึงประมวลผลรูปภาพ แยกแยะวัตถุที่อยู่ในภาพ

สอนเขียน Prompt ChatGPT สั่งให้ AI ตรวจเช็คเงื่อนไขที่จำเป็น ก่อนทำงาน – Prompt Engineering ep.3

ChatGPT เป็น LLM ระดับ Advance มันจะพยายามอย่างที่สุดที่จะตอบคำถามที่เราป้อนให้ จากข้อมูลมหาศาลที่มันถูกเทรนมา อย่างไรก็ตามมันไม่มีข้อมูลความรู้จากโลกความเป็นจริงที่เป็นปัจจุบัน ไม่สามารถเข้าใจบริบทอื่น ๆ นอกจากที่อยู่ในใน Training Data ดังนั้นเมื่อเราถามคำถาม หรือสั่งอะไรที่เป็นไปไม่ได้ บางทีมันจะสร้างคำตอบที่ฟังดูดี แต่อาจจะไม่เป็นความจริง ตอบกลับมาให้เราได้ ทางแก้ก็คือเราควรรู้เท่าทัน เข้าใจว่ามันคือ โปรแกรมคอมพิวเตอร์โปรแกรมหนึ่ง ซึ่งมีข้อจำกัด ไม่สามารถรู้ทุกอย่าง ไม่สามารถทำได้ทุกอย่าง ไม่สามารถทำสิ่งที่เป็นไปไม่ได้ให้เป็นไปได้ และสั่งให้มันตรวจเช็คเงื่อนไขที่จำเป็นก่อนทำงาน ไม่ได้ก็ตอบว่าไม่ได้ตรง ๆ

สอนเขียน Prompt ChatGPT ระบุรูปแบบโครงสร้างผลลัพท์ – Prompt Engineering ep.2

ใน Prompt Engineering สิ่งหนึ่งที่ที่ไม่ควรมองข้าม คือ การระบุรูปแบบโครงสร้างของผลลัพท์ที่เราต้องการ เช่น Plain Text, CSV, JSON, HTML เหตุผลข้อแรกก็คือ มันช่วยให้ผลลัพท์ที่ได้ ถูกจัดให้อยู่ในรูปแบบที่เราคาดหวัง สามารถนำไปใช้งานต่อไปทันที ตามปกติ ในระบบงานไอที Output จากระบบหนึ่งไปเป็น Input ของอีกระบบนึง ต่อไปเรื่อย ๆ เป็นเครือข่ายซับซ้อน ขึ้นกับแต่ละองค์กร ซึ่งแต่ละระบบก็จะคาดหวัง Input รูปแบบโครงสร้างข้อมูลที่แตกต่างกันไป เมื่อเราระบุรูปแบบโครงสร้างข้อมูลที่ต้องการ ใน Prompt ให้ LLM อย่างชัดเจนตั้งแต่ต้น ทำให้เราแน่ใจว่าสามารถบูรณาการระบบงานต่าง ๆ ได้อย่างไร้รอยต่อ

สอนเขียน Prompt ChatGPT ใช้เครื่องหมายวรรคตอน คั่นอินพุต และคำสั่ง – Prompt Engineering ep.1

Prompt Engineering เป็นส่วนสำคัญในความสำเร็จของโมเดลภาษาขนาดใหญ่ (LLM) แบบ ChatGPT ที่จะเปิดโอกาสให้เราสามารถสื่อสาร เสริมสร้างความเข้าใจระหว่างมนุษย์ และ AI เป็นการใช้เทคโนโลยีอย่างสร้างสรรค์ พลิกโฉมการทำงานในอนาคตอันใกล้ ด้วยการออกแบบ Prompt อย่างถูกวิธี เราสามารถระบุคำสั่งและบริบทที่ต้องการได้อย่างกระจ่าง แจ่มแจ้ง ชัดเจน ไม่คลุมเครือ เพื่อกำหนดทิศทาง และเป้าหมาย ทำให้ผลลัพท์ที่ได้จากโมเดลภาษา มีความถูกต้อง แม่นยำ และสอดคล้องกับความต้องการของเรา

Prompt Engineering คืออะไร

Prompt Engineering คือ เป็นคอนเซ็ปต์ใหม่ ในวิชาปัญญาประดิษฐ์ (AI) อยู่ในสาขา ประมวลผลภาษาธรรมชาติ (Natural Language Processing, NLP) โดยโฟกัสที่การพัฒนาและปรับ Prompt ให้เหมาะสมสำหรับการใช้สั่งการโมเดลภาษาขนาดใหญ่ (Large Language Model, LM) อย่างมีประสิทธิภาพ Prompt Engineering เกี่ยวข้องกับทักษะและเทคนิคในการทำความเข้าใจขีดความสามารถและข้อจำกัดของโมเดลภาษาขนาดใหญ่ (LLM)